Transkodowanie wideo i pipeline'y broadcastowe

Projektujemy i utrzymujemy profesjonalne systemy transkodowania wideo — dostarczanie HLS, LL-HLS, CMAF i DASH, mastering IMF i ProRes, batch processing kopii master dowolnego rozmiaru, wykrywanie ad-break przez AI, architektury mikroserwisowe z workerami i agentami AI oraz transkodowanie z akceleracją sprzętową na CPU, GPU i wyspecjalizowanych VPU takich jak NETINT.

Transkodowanie wieloformatowe: HLS, CMAF, DASH, IMF, ProRes

Budujemy transcodery, które mówią językiem nowoczesnego broadcastu i OTT. Od HLS dla urządzeń Apple i Smart TV, low-latency CMAF i DASH z drabinami ABR per-title dla streamingu, po mastering IMF i mezzaniny ProRes dla postprodukcji — Twoje treści przepływają między formatami bez utraty jakości, z deterministycznym timingiem, klatkowo dokładnymi cięciami i w pełni audytowanymi metadanymi.

Pod maską pracujemy z prawdziwymi specyfikacjami: ISO/IEC 23001-7 Common Encryption (CENC) dla pakowania cross-DRM, MPEG-DASH (ISO/IEC 23009-1) z SegmentTimeline i SegmentTemplate, RFC 8216bis dla HLS, ISO/IEC 23000-19 dla CMAF, SMPTE ST 2067 dla IMF i SMPTE ST 2110 dla broadcastu SDI/IP. Dobieramy odpowiedni typ manifestu, długość segmentu, profile/level/tier kodeka — i dokumentujemy każdą decyzję, by Twój zespół operacyjny mógł odtworzyć, skalować i wdrożyć rozwiązanie w produkcji.

- Pakowanie HLS / CMAF / DASH z drabinami ABR i kodowaniem per-title dla optymalnej jakości na każdym bitrate, na każdym urządzeniu.

- Ingest i assembly IMF (Interoperable Master Format) z obsługą CPL/PKL/OPL i pakietów supplemental.

- Mezzaniny Apple ProRes 422/4444/HQ/XQ, DNxHR/DNxHD, JPEG 2000 i mastering uncompressed.

- Klatkowo dokładne mapowanie audio (5.1 / 7.1 / Dolby Atmos), napisy, markery SCTE-35 i pełna zgodność z SMPTE.

Streaming HLS w szczegółach: LL-HLS, FairPlay i Interstitials

HLS pozostaje dominującym protokołem streamingu — od Apple TV i iOS po Smart TV, set-top-boxy i Androida. Budujemy pipeline'y HLS we wszystkich wariantach: legacy MPEG-TS dla maksymalnej zgodności urządzeń, fMP4/CMAF dla nowoczesnych playerów, Low-Latency HLS dla dostarczania w czasie rzeczywistym i FairPlay Streaming dla ochrony treści premium. Jeden pipeline, każdy ekran, przewidywalne zachowanie.

Zgodność z Apple HLS Authoring Specification (Tier 1): manifesty multi-rendition z napisami IMSC1, wariantami audio AAC LC i AC-4, HEVC Main 10 z Dolby Vision profile 8.4 i fallbackiem HDR10. Dla LL-HLS precyzyjnie dostrajamy długość partial segmentu (200-500 ms), part-target value, flagę EXT-X-PART independent, EXT-X-PRELOAD-HINT dla następnego part i blocking playlist reload przez parametry query _HLS_msn / _HLS_part. Efekt: manifest, który kochają playery i który Apple mediastreamvalidator akceptuje za pierwszym razem.

- LL-HLS (Low-Latency HLS) z partial segments, EXT-X-PART, preload hints i blocking playlist reload — opóźnienie glass-to-glass poniżej 3 sekund dla wydarzeń live.

- HLS oparty na fMP4/CMAF z dostarczaniem byte-range i common-encryption (CENC) — wspólne segmenty dla HLS i DASH, mniej plików i niższe koszty storage.

- HLS Interstitials dla stitched live ads, server-guided mid-rolls, dynamicznej wymiany kreacji i plansz contentowych — bez przerywania sesji playera.

- FairPlay Streaming, szyfrowanie AES-128 i SAMPLE-AES, multi-DRM z Widevine i PlayReady — hollywoodzki poziom ochrony treści dla live i VOD.

CMAF i streaming chunked o niskim opóźnieniu

CMAF (Common Media Application Format, ISO/IEC 23000-19) to fundament nowoczesnego adaptive streamingu — jeden zestaw segmentów fMP4, jeden wspólny init, dwa manifesty (HLS i DASH). Projektujemy struktury asetów CMAF, które grają na iOS, Androidzie, w przeglądarkach i na Smart TV z jednego origin, z bit-w-bit identyczną treścią i znacząco obniżonym kosztem pakowania. Mniej duplikacji, niższe rachunki CDN, prostsze audyty.

Dla low-latency idziemy poza specyfikację: chunki CMAF po 200 ms, HTTP Chunked Transfer Encoding (CTE) na origin i CDN, DASH SegmentTimeline z adresacją $Time$, dostrajanie availabilityTimeOffset i player-side adjustments dla chunk-aligned ABR switching. W połączeniu z HTTP/2 (lub HTTP/3 / QUIC) i poprawnie skonfigurowanym cache CDN osiągamy 2-4 sekundy end-to-end latency z pełnym ABR — porównywalnie z LL-HLS, z szerszym wsparciem playerów i jednym grafem asetów.

- Strukturyzacja asetów CMAF z common-init, common-encryption (CENC) i wspólnymi segmentami fMP4 — jedna biblioteka, każdy player.

- Low-Latency CMAF (CMAF-LL) z chunked CTE delivery, DASH SegmentTimeline, availabilityTimeOffset i tuningiem playera pod chunk-aligned ABR.

- Nagłówki CMCD / CMSD (Common Media Client/Server Data) dla precyzyjnej telemetrii QoE w całym łańcuchu dostarczania — od playera do origin.

- Pakowanie DRM z CENC na tym samym fMP4 — FairPlay (cbcs), Widevine i PlayReady (cenc/cbcs) z jednego asetu, multi-DRM rights.

Pliki master IMF i mastering interaktywnego audio IMAF

IMF (Interoperable Master Format, SMPTE ST 2067) to lingua franca dostarczania treści high-end — używana przez Netflix, Apple TV+, Amazon Prime Video i hollywoodzkich majorsów. Składamy i walidujemy pakiety IMF end-to-end: OPL (Output Profile List), CPL (Composition Playlist), PKL (Packing List) i ASSETMAP — wraz z opakowaniami MXF, esencją wideo JPEG 2000, audio MGA / Dolby Atmos i napisami IMSC1. Każdy pakiet jest walidowany względem IMF Application 2 / 2E / 4 / 5 i Netflix Originals Delivery Specifications.

Dla audio interaktywnego i imersyjnego przechodzimy do IMAF (Interactive Music Application Format, ISO/IEC 23000-12) i formatów object-based — Dolby Atmos ADM BWF, MPEG-H 3D Audio i AC-4 z JOC. Budujemy workflow masteringu obsługujące pojedyncze stems, struktury grup, presentation rules i imersyjne kanały bed z klatkową synchronizacją do toru wideo IMF. Ten sam pipeline produkuje deliverables broadcastowe, mezzaniny OTT i interaktywne mastery muzyczne z jednego źródła.

- IMF Application 2/2E dla broadcastu i 4/5 dla cinema — autoring CPL/PKL/OPL/ASSETMAP z pełną zgodnością SMPTE ST 2067.

- Kodowanie mezzanine JPEG 2000 (J2K), pakowanie MXF OP1a z timecode-precyzyjnym wstawianiem pakietów supplemental i version-edits.

- Audio object-based i imersyjne — Dolby Atmos ADM BWF, MPEG-H 3D Audio, IMAF interaktywne multitrack masters, AC-4 / E-AC-3 JOC dla broadcastu.

- Walidacja względem Netflix Photon, Apple TV+ delivery specs, Amazon AIV i profili ingest broadcasterów — pakiety dostarczane za pierwszym razem.

Batch processing kopii master dowolnego rozmiaru

Wieloterabajtowe mastery studyjne, tysiące legacy plików archiwalnych, codzienne wgrywki VOD — nasze pipeline'y są zbudowane, by je przetrawić. Projektujemy rozproszony batch processing, który skaluje się horyzontalnie w wielu regionach i poziomach storage, ze sprytnym shardingiem, wznowialnymi zadaniami i przewidywalnym kosztem za minutę przetworzonego wideo.

- Rozproszone batch transkodowanie dla bibliotek od gigabajtów do petabajtów, z wznowialnymi idempotentnymi zadaniami.

- Inteligentna orkiestracja: kolejki priorytetowe, scheduling świadomy SLA, kodowanie deadline-driven dla treści live i krytycznych czasowo.

- Kontrola kosztów: telemetria per-zadanie, przewidywalne budżety kodowania i automatyczny right-sizing zasobów obliczeniowych.

Wykrywanie ad-break przez AI i inteligentne umieszczanie reklam

Gdzie dokładnie umieścić reklamę? Tworzymy moduły AI, które oglądają Twoje treści i precyzyjnie odpowiadają na to pytanie. Łącząc detekcję zmian scen, analizę pauz audio, gramatykę ujęć i modele ML świadome treści, identyfikujemy najbardziej naturalne pozycje ad-break — chronimy doświadczenie widza, jednocześnie maksymalizując monetyzację.

- Wykrywanie optymalnych punktów ad-break przez AI: granice scen, przerwy w dialogach, spokojne fragmenty akcji i przejścia między rozdziałami.

- Automatyczne generowanie i wstawianie markerów SCTE-35 / SCTE-104 do strumieni HLS / DASH / CMAF.

- Brand safety i klasyfikacja treści, by reklama nie pojawiała się obok wrażliwych scen.

Architektura wielo-mikroserwisowa z workerami i agentami AI

Pipeline'y wideo padają głośno, gdy padają. Nasze są zaprojektowane, by nie padać. Dzielimy workflow na sfokusowane mikroserwisy — ingest, probe, transcode, package, QC, deliver — każdy działa jako niezależny pool workerów ze ścisłymi kontraktami. Agenci AI pracują nad tym i w czasie rzeczywistym podejmują decyzje o routingu, retry, fallback jakości i alokacji zasobów.

- Modułowe mikroserwisy do ingest, probe, transkodowania, pakowania, QC i dostarczania CDN — każdy skalowalny niezależnie.

- Pule workerów na Kubernetes / Nomad z autoscalingiem, kolejkami priorytetowymi (RabbitMQ, NATS, Kafka) i semantyką exactly-once.

- Agenci AI do adaptacyjnego schedulingu, wykrywania anomalii, oceny jakości (VMAF/PSNR/SSIM) i self-healing recovery.

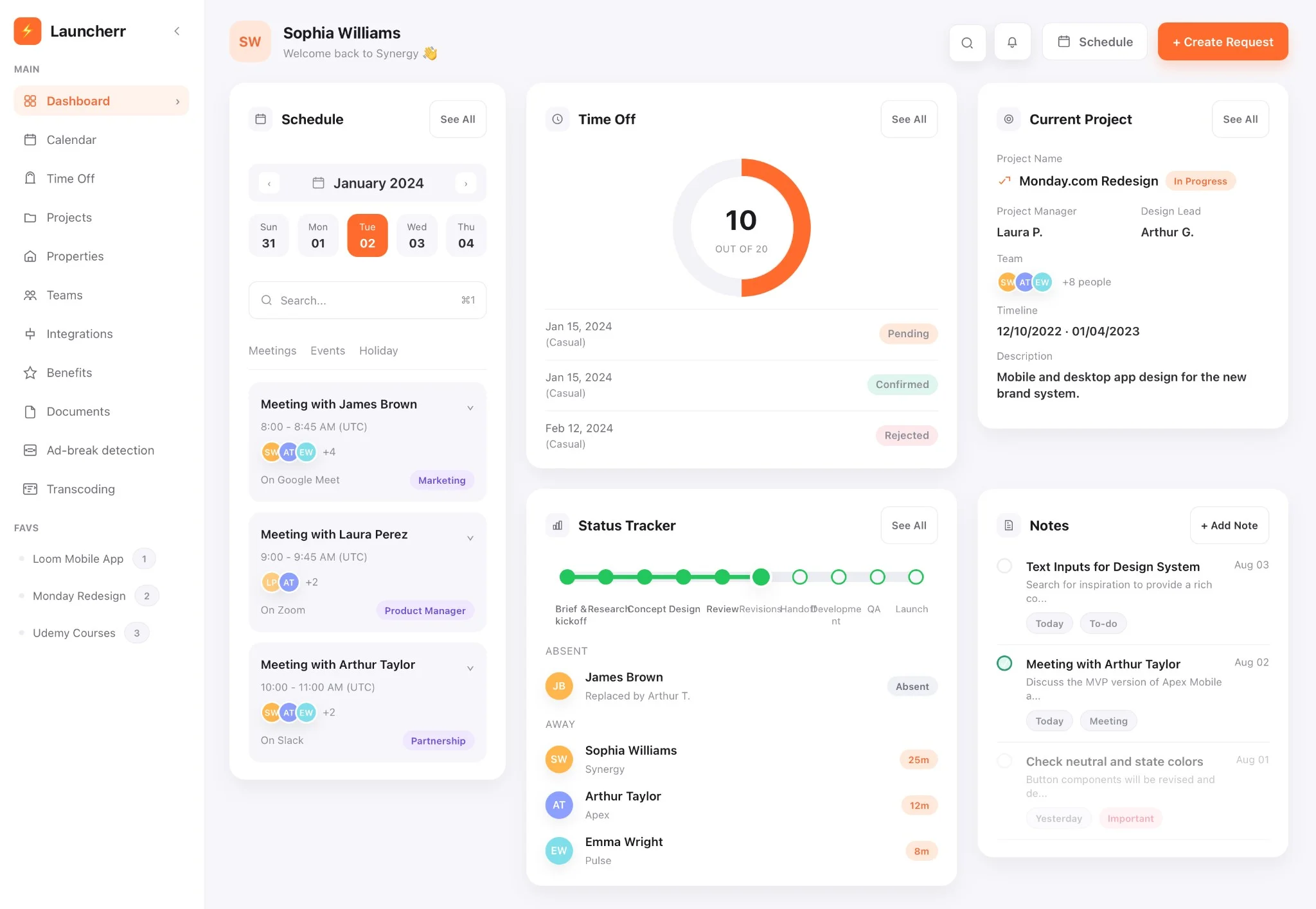

- Pełna observability: rozproszony tracing, audit logi per-asset, metryki OpenTelemetry i dashboardy SLA.

Transkodowanie z akceleracją sprzętową: VPU, GPU, CPU i NETINT

Kodowanie 4K HDR, które zajmuje 30 minut na CPU, na NETINT VPU trwa 3 minuty. Inżynierujemy hybrydowe farmy transkodujące, które dopasowują każde zadanie do właściwego krzemu — dedykowane VPU dla gęstych kanałów 24/7, GPU dla workflow wzbogaconych AI, CPU dla premium quality i edge case'ów — i wyciskają każdy cent efektywności z Twojego sprzętu.

Nasze integracje NETINT to nie "wrzućmy do FFmpeg, jakoś to będzie". Pracujemy bezpośrednio z serią Quadra T1A i T2A przez SDK libxcoder i patche NETINT do FFmpeg: jawny routing pipeline'u YUV przez on-card scaler, hardware overlay/blend dla brandowanych watermarków, kodowanie AV1 w jakości broadcast (NETINT Quadra to jeden z nielicznych ASIC-ów ze sprzętowym AV1) oraz inferencja AI na tym samym krzemie dla zadań takich jak scene-change detection, maskowanie logotypów i quality scoring. Dla NVIDII tunujemy każdy parametr NVENC — preset (p1-p7), tuning info (UHQ/HQ/LL), rate-control mode (CBR-HQ / VBR-HQ), lookahead, strukturę B-frame i adaptive quantization — na podstawie realnych krzywych VMAF per-title, a nie fabrycznych defaultów. Ta sama głębokość dla Intel Quick Sync przez oneVPL, AMD VCN przez AMF i kodeków CPU (x264 --tune psnr/ssim, x265 --no-sao, SVT-AV1 preset 4-8, VVenC) dla deliverables golden-master.

- Integracja NETINT Quadra VPU dla ultra-gęstego kodowania H.264 / H.265 / AV1 w jakości broadcast.

- Akceleracja GPU przez NVIDIA NVENC / NVDEC, AMD VCN i Intel Quick Sync / Arc dla tanich, wydajnych pipeline'ów.

- Kodowanie CPU na x264 / x265 / SVT-AV1 / VVenC, dostrojone pod premium VOD i dostarczanie golden-master.

- Hybrydowy scheduling, który kieruje każde zadanie na optymalny akcelerator — wymierne oszczędności energii, czasu i kosztów cloudowych.

Chcesz zbudować lub zmodernizować platformę transkodowania wideo? Skontaktuj się z nami, zaprojektujemy wysokowydajny pipeline dopasowany do Twoich formatów, sprzętu i celów biznesowych.