Transcodage vidéo et pipelines broadcast

Nous concevons et exploitons des systèmes professionnels de transcodage vidéo — diffusion HLS, LL-HLS, CMAF et DASH, mastering IMF et ProRes, traitement batch de copies master de toute taille, détection d'ad-break par IA, architectures microservices avec workers et agents IA, et transcodage accéléré matériellement sur CPU, GPU et VPU spécialisés comme NETINT.

Transcodage multi-format : HLS, CMAF, DASH, IMF, ProRes

Nous construisons des transcodeurs qui parlent la langue du broadcast moderne et de l'OTT. Du HLS pour appareils Apple et Smart TV, CMAF basse latence et DASH avec échelles ABR per-title pour le streaming, au mastering IMF et aux mezzanines ProRes pour la post-production — votre contenu circule entre les formats sans perte de qualité, avec un timing déterministe, des coupes à la frame près et des métadonnées entièrement auditables.

Sous le capot, nous travaillons avec les vraies spécifications : ISO/IEC 23001-7 Common Encryption (CENC) pour le packaging cross-DRM, MPEG-DASH (ISO/IEC 23009-1) avec SegmentTimeline et SegmentTemplate, RFC 8216bis pour HLS, ISO/IEC 23000-19 pour CMAF, SMPTE ST 2067 pour IMF et SMPTE ST 2110 pour le broadcast SDI/IP. Nous choisissons le bon type de manifeste, la durée de segment, le profile/level/tier du codec — et documentons chaque décision pour que votre équipe ops puisse reproduire, scaler et livrer la solution.

- Empaquetage HLS / CMAF / DASH avec échelles ABR et encodage per-title pour une qualité optimale à chaque bitrate, sur chaque appareil.

- Ingest et assemblage IMF (Interoperable Master Format) avec gestion CPL/PKL/OPL et paquets supplémentaires.

- Mezzanines Apple ProRes 422/4444/HQ/XQ, DNxHR/DNxHD, JPEG 2000 et mastering uncompressed.

- Mappage audio à la frame près (5.1 / 7.1 / Dolby Atmos), sous-titres, marqueurs SCTE-35 et conformité SMPTE complète.

Streaming HLS en détail : LL-HLS, FairPlay et Interstitials

HLS reste le protocole de streaming dominant — d'Apple TV et iOS aux Smart TVs, set-top boxes et Android. Nous construisons des pipelines HLS dans toutes leurs déclinaisons : MPEG-TS legacy pour une compatibilité maximale des appareils, fMP4/CMAF pour les players modernes, Low-Latency HLS pour la diffusion en temps réel et FairPlay Streaming pour la protection des contenus premium. Un seul pipeline, chaque écran, comportement prévisible.

Conformité avec l'Apple HLS Authoring Specification (Tier 1) : manifestes multi-rendition avec sous-titres IMSC1, variantes audio AAC LC et AC-4, HEVC Main 10 avec Dolby Vision profile 8.4 et fallbacks HDR10. Pour LL-HLS, nous tunons finement la durée du partial segment (200-500 ms), la part-target value, le flag EXT-X-PART independent, EXT-X-PRELOAD-HINT pour la part suivante et le blocking playlist reload via les query parameters _HLS_msn / _HLS_part. Résultat : un manifeste que les players adorent et qu'Apple mediastreamvalidator approuve dès la première passe.

- LL-HLS (Low-Latency HLS) avec partial segments, EXT-X-PART, preload hints et blocking playlist reload — latence glass-to-glass sous 3 secondes pour les événements live.

- HLS basé sur fMP4/CMAF avec diffusion byte-range et common-encryption (CENC) — segments partagés entre HLS et DASH, moins de fichiers et coûts de stockage réduits.

- HLS Interstitials pour publicités stitched live, mid-rolls server-guided, remplacement dynamique de créatifs et écrans de contenu — sans casser la session du player.

- FairPlay Streaming, chiffrement AES-128 et SAMPLE-AES, multi-DRM avec Widevine et PlayReady — protection de contenu de niveau Hollywood pour live et VOD.

CMAF et streaming chunked basse latence

CMAF (Common Media Application Format, ISO/IEC 23000-19) est le fondement du streaming adaptatif moderne — un seul jeu de segments fMP4, un init commun, deux manifestes (HLS et DASH). Nous concevons des structures d'assets CMAF qui jouent sur iOS, Android, dans les navigateurs et sur les Smart TV depuis un origin unique, avec un contenu identique au bit près et un coût de packaging significativement réduit. Moins de duplication, factures CDN plus basses, audits plus simples.

Pour la basse latence, nous allons au-delà de la spec : chunks CMAF de 200 ms, HTTP Chunked Transfer Encoding (CTE) sur l'origin et le CDN, DASH SegmentTimeline avec adressage $Time$, tuning du availabilityTimeOffset et ajustements côté player pour le switching ABR aligné sur les chunks. Combiné à HTTP/2 (ou HTTP/3 / QUIC) et un cache CDN correctement configuré, on atteint 2-4 secondes de latence end-to-end avec ABR complet — comparable au LL-HLS, avec un support player plus large et un graphe d'asset unique.

- Structuration d'assets CMAF avec common-init, common-encryption (CENC) et segments fMP4 partagés — une bibliothèque, chaque player.

- Low-Latency CMAF (CMAF-LL) avec livraison chunked CTE, DASH SegmentTimeline, availabilityTimeOffset et tuning player pour ABR aligné sur les chunks.

- Headers CMCD / CMSD (Common Media Client/Server Data) pour une télémétrie QoE précise sur toute la chaîne de livraison — du player à l'origin.

- Packaging DRM avec CENC sur le même fMP4 — FairPlay (cbcs), Widevine et PlayReady (cenc/cbcs) depuis un asset unique, multi-DRM rights.

Master files IMF et mastering audio interactif IMAF

IMF (Interoperable Master Format, SMPTE ST 2067) est la lingua franca de la livraison de contenu haut de gamme — utilisé par Netflix, Apple TV+, Amazon Prime Video et les majors hollywoodiennes. Nous assemblons et validons des packages IMF de bout en bout : OPL (Output Profile List), CPL (Composition Playlist), PKL (Packing List) et ASSETMAP — avec wrappers MXF, essence vidéo JPEG 2000, audio MGA / Dolby Atmos et sous-titres IMSC1. Chaque package est validé contre IMF Application 2 / 2E / 4 / 5 et les Netflix Originals Delivery Specifications.

Pour l'audio interactif et immersif, nous passons à IMAF (Interactive Music Application Format, ISO/IEC 23000-12) et aux formats object-based — Dolby Atmos ADM BWF, MPEG-H 3D Audio et AC-4 avec JOC. Nous construisons des workflows de mastering qui gèrent les stems individuels, les structures de groupe, les presentation rules et les bed channels immersifs avec une synchronisation à la frame près sur la piste vidéo IMF. Le même pipeline produit deliverables broadcast, mezzanines OTT et masters de musique interactive depuis une seule source.

- IMF Application 2/2E pour broadcast et 4/5 pour cinéma — authoring CPL/PKL/OPL/ASSETMAP en pleine conformité SMPTE ST 2067.

- Encodage mezzanine JPEG 2000 (J2K), wrapping MXF OP1a avec insertion timecode-précise de packages supplemental et version-edits.

- Audio object-based et immersif — Dolby Atmos ADM BWF, MPEG-H 3D Audio, masters multitrack interactifs IMAF, AC-4 / E-AC-3 JOC pour le broadcast.

- Validation contre Netflix Photon, Apple TV+ delivery specs, Amazon AIV et profils ingest des broadcasters — packages livrés acceptés du premier coup.

Traitement batch de copies master de toute taille

Masters studio de plusieurs téraoctets, milliers de fichiers d'archives legacy, drops VOD quotidiens — nos pipelines sont construits pour les absorber. Nous concevons un traitement batch distribué qui passe à l'échelle horizontalement à travers les régions et les niveaux de stockage, avec sharding intelligent, jobs reprenables et coût prévisible par minute de vidéo traitée.

- Transcodage batch distribué pour bibliothèques du gigaoctet au pétaoctet, avec jobs reprenables et idempotents.

- Orchestration intelligente : files prioritaires, scheduling conscient du SLA, encodage piloté par deadlines pour le live et les contenus critiques en temps.

- Maîtrise des coûts : télémétrie par job, budgets d'encodage prévisibles et right-sizing automatique du compute.

Détection d'ad-break par IA et placement intelligent

Où placer exactement la publicité ? Nous construisons des modules IA qui regardent votre contenu et répondent précisément à cette question. En combinant détection de changements de scène, analyse de silences audio, grammaire de plans et modèles ML conscients du contenu, nous identifions les positions d'ad-break les plus naturelles — protégeant l'expérience spectateur tout en maximisant la monétisation.

- Détection IA des points d'ad-break optimaux : limites de scènes, pauses dans les dialogues, accalmies d'action et transitions de chapitres.

- Génération automatique et insertion de marqueurs SCTE-35 / SCTE-104 dans les flux HLS / DASH / CMAF.

- Brand safety et classification de contenu pour éviter de placer des publicités à côté de scènes sensibles.

Architecture multi-microservices avec workers et agents IA

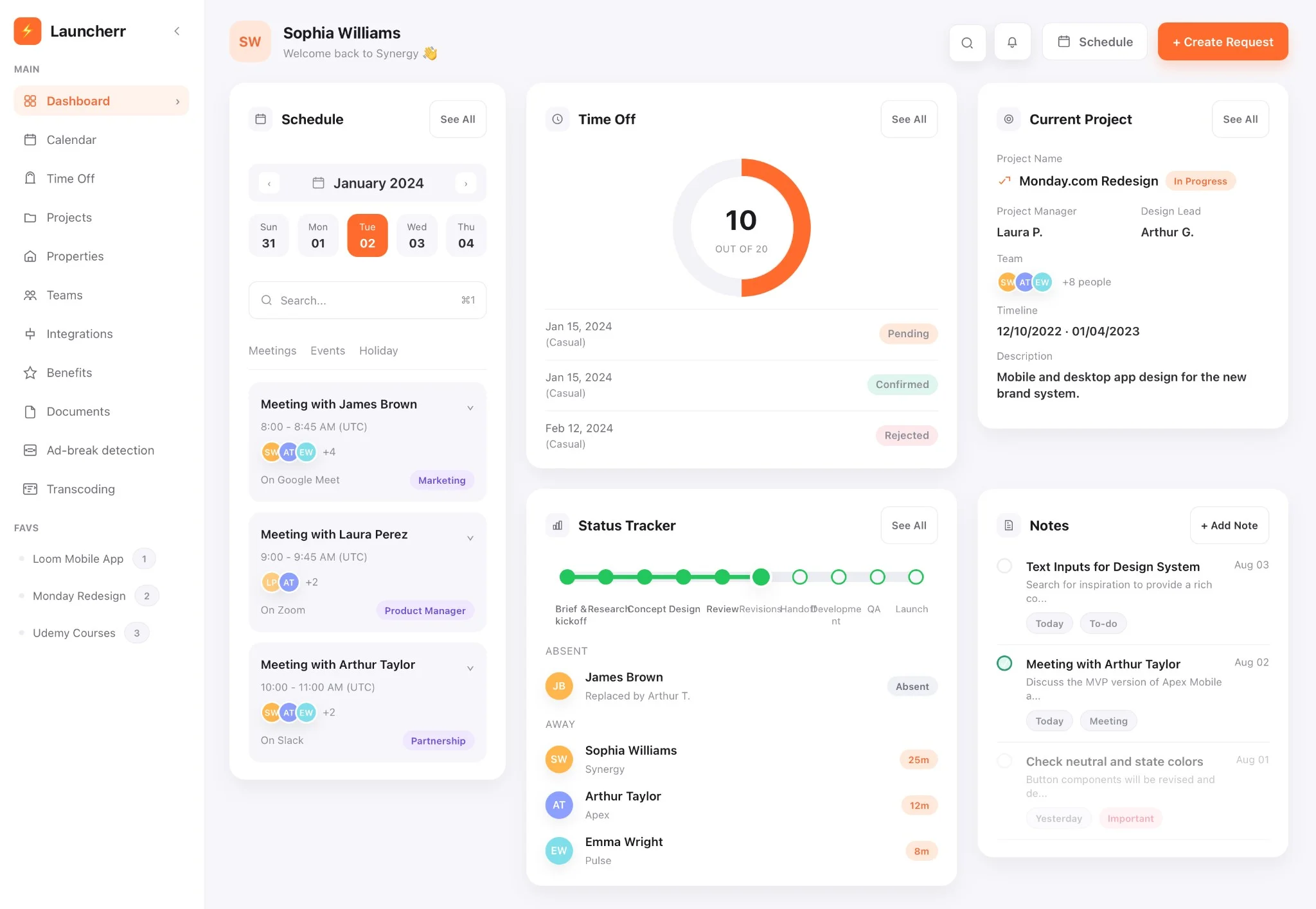

Les pipelines vidéo échouent bruyamment quand ils échouent. Les nôtres sont conçus pour ne pas le faire. Nous découpons le workflow en microservices ciblés — ingest, probe, transcode, package, QC, deliver — chacun s'exécutant comme un pool de workers indépendant avec des contrats stricts. Les agents IA travaillent au-dessus, prenant en temps réel des décisions sur le routage, les retries, les fallbacks de qualité et l'allocation des ressources.

- Microservices modulaires pour ingest, probe, transcodage, packaging, QC et livraison CDN — chacun scalable indépendamment.

- Pools de workers sur Kubernetes / Nomad avec autoscaling, files prioritaires (RabbitMQ, NATS, Kafka) et sémantique exactly-once.

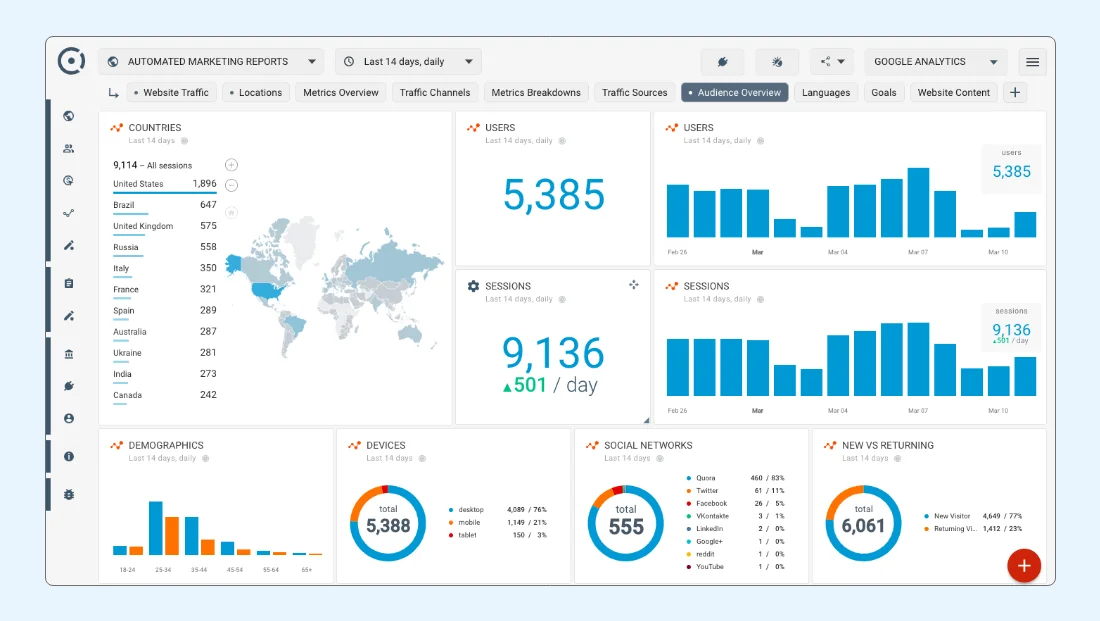

- Agents IA pour scheduling adaptatif, détection d'anomalies, scoring qualité (VMAF/PSNR/SSIM) et récupération self-healing.

- Observability complète : tracing distribué, logs d'audit par asset, métriques OpenTelemetry et tableaux de bord SLA.

Transcodage avec accélération matérielle : VPU, GPU, CPU et NETINT

Un encodage 4K HDR qui prend 30 minutes sur CPU se fait en 3 minutes sur un VPU NETINT. Nous concevons des fermes de transcodage hybrides qui orientent chaque job vers le bon silicium — VPU dédiés pour les chaînes haute densité 24/7, GPU pour les workflows enrichis par l'IA, CPU pour la qualité premium et les edge cases — et tirent chaque centime d'efficacité du matériel que vous possédez.

Nos intégrations NETINT ne sont pas du « on balance dans FFmpeg, on espère le meilleur ». Nous travaillons directement avec les séries Quadra T1A et T2A via le SDK libxcoder et les patches NETINT pour FFmpeg : routing explicite du pipeline YUV à travers le scaler on-card, hardware overlay/blend pour les watermarks brandés, encodage AV1 en qualité broadcast (NETINT Quadra est l'un des rares ASIC avec AV1 matériel) et inférence IA sur le même silicium pour des tâches comme la scene-change detection, le masquage de logos et le quality scoring. Pour NVIDIA, nous tunons chaque paramètre NVENC — preset (p1-p7), tuning info (UHQ/HQ/LL), rate-control mode (CBR-HQ / VBR-HQ), lookahead, structure B-frame et adaptive quantization — sur la base de vraies courbes VMAF per-title, pas des défauts d'usine. La même profondeur s'applique à Intel Quick Sync via oneVPL, AMD VCN via AMF et aux codecs CPU (x264 --tune psnr/ssim, x265 --no-sao, SVT-AV1 preset 4-8, VVenC) pour les deliverables golden-master.

- Intégration NETINT Quadra VPU pour un encodage ultra-dense H.264 / H.265 / AV1 en qualité broadcast.

- Accélération GPU avec NVIDIA NVENC / NVDEC, AMD VCN et Intel Quick Sync / Arc pour des pipelines à bas coût et haut débit.

- Encodage CPU avec x264 / x265 / SVT-AV1 / VVenC, ajusté pour le VOD premium et la livraison golden-master.

- Scheduling hybride qui route chaque job vers l'accélérateur optimal — économies mesurables sur l'énergie, le temps et les factures cloud.

Vous souhaitez construire ou moderniser une plateforme de transcodage vidéo ? Contactez-nous pour concevoir un pipeline haute performance adapté à vos formats, votre matériel et vos objectifs business.